Les limites des détecteurs d’IA : ce qu’ils ne voient pas

affichent des précisions de 90 à 99 % dans leurs communications marketing. Mais la réalité est plus complexe — et leurs angles morts sont nombreux. Ce guide analyse honnêtement ce que les détecteurs IA ne peuvent pas voir, pourquoi ils se trompent, et comment utiliser ces outils de façon responsable en tenant compte de leurs limites.

Pour comprendre comment la détection fonctionne dans le meilleur des cas, consultez notre guide complet pour détecter un texte généré par IA. Pour une analyse approfondie de la fiabilité réelle de ces outils, consultez notre article sur la fiabilité réelle des détecteurs IA.

Ce que les détecteurs mesurent — et ce qu’ils ne mesurent pas

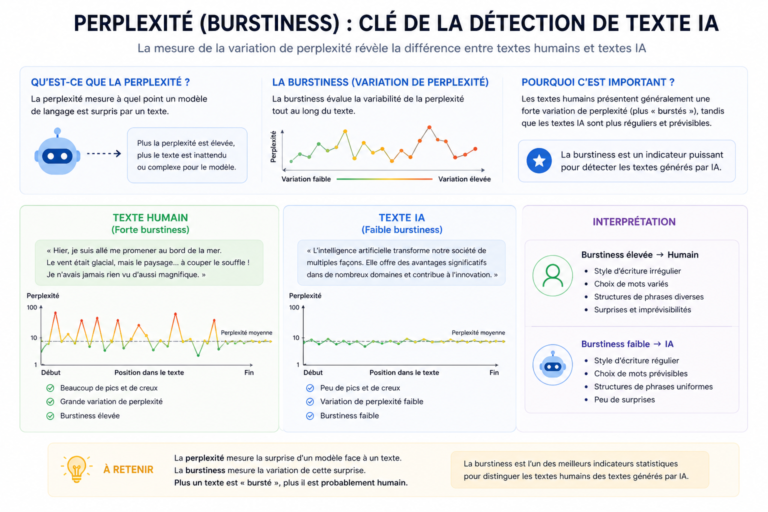

Commençons par clarifier ce que fait réellement un détecteur IA. Il analyse des patterns statistiques du texte — principalement la perplexité (prévisibilité des mots) et le burstiness (variabilité du rythme des phrases) — et les compare à des distributions apprises sur des corpus de textes humains et de textes IA.

Ce qu’un détecteur ne fait pas :

- Il n’a pas accès aux historiques de ChatGPT, Claude ou Gemini

- Il ne « reconnaît » pas un texte IA comme un programme antivirus reconnaît un virus connu

- Il ne mesure pas la vérité factuelle du texte

- Il ne mesure pas la qualité argumentative

- Il ne détecte pas l’intention de l’auteur

Il calcule une probabilité statistique — pas une certitude. C’est la première et la plus fondamentale de ses limites.

Limite 1 — Les faux positifs sur les textes humains formels

C’est l’erreur la plus problématique dans un contexte académique ou professionnel : accuser à tort un texte humain d’avoir été généré par une IA.

Les profils à risque élevé

Les locuteurs non natifs Des études publiées en 2023 ont montré que les détecteurs IA produisent des taux de faux positifs significativement plus élevés sur les textes rédigés par des non-natifs anglophones. Leur écriture, plus formelle et moins idiomatique, ressemble statistiquement aux patterns IA.

Une étude de l’Université de Stanford (2023) a soumis des textes d’étudiants internationaux à plusieurs détecteurs — les taux de faux positifs atteignaient 61 % pour certains outils sur des textes entièrement humains rédigés par des non-natifs.

Les textes académiques très formels Un chercheur qui rédige dans un style académique standardisé — phrases passives, structures répétitives, jargon technique contraint — présente naturellement un faible burstiness et une perplexité réduite. Ces caractéristiques ressemblent statistiquement aux textes IA.

Les auteurs avec un style très régulier Certains auteurs ont naturellement un style homogène et prévisible — peu de variabilité dans la longueur des phrases, vocabulaire précis et constant. Ce style peut déclencher des faux positifs.

Limite 2 — Les faux négatifs sur les textes IA remaniés

À l’opposé des faux positifs, les faux négatifs sont des textes IA que les détecteurs ne repèrent pas.

Les techniques de contournement efficaces

La paraphrase manuelle Un texte IA significativement réécrit par un humain — reformulé, restructuré, enrichi d’exemples personnels — peut facilement passer sous les radars. Les détecteurs analysent les patterns statistiques de surface, pas la profondeur sémantique.

La paraphrase automatique Des outils comme QuillBot, Quillbot AI, ou des services de spin d’articles modifient les patterns statistiques du texte. Un texte IA paraphrasé peut voir son score de détection chuter de 30 à 50 points selon les outils.

La traduction aller-retour Traduire un texte IA de l’anglais vers le français puis retraduit via DeepL ou Google Translate modifie les patterns statistiques de façon significative. Les détecteurs entraînés sur l’anglais peinent particulièrement sur ces textes doublement traduits.

La fragmentation en petits passages Générer du texte IA par petits blocs (100-200 mots à la fois) plutôt qu’en un seul prompt produit des patterns légèrement plus variables — et des scores de détection généralement plus bas.

L’augmentation de température Les modèles IA peuvent être configurés avec une « température » plus élevée (paramètre qui introduit plus d’aléatoire dans les choix de mots). Un texte généré avec une haute température présente plus de variabilité lexicale et un burstiness plus élevé — deux signaux qui réduisent la probabilité de détection.

Limite 3 — Les textes courts sont mal analysés

Tous les détecteurs produisent des résultats significativement moins fiables sur les textes courts.

En dessous de 200 à 300 mots, il n’y a pas assez de données statistiques pour que les algorithmes puissent calculer des valeurs de perplexité et de burstiness significatives. Les scores sur les textes courts sont particulièrement variables et peu représentatifs.

Conséquence pratique : pour un email, une réponse courte, un commentaire de quelques lignes — les détecteurs IA sont quasi inutilisables de façon fiable. Un score élevé sur un texte court ne signifie presque rien.

Limite 4 — La dépendance à la langue du corpus d’entraînement

La très grande majorité des détecteurs IA sont entraînés principalement sur des corpus en anglais. Leurs performances se dégradent significativement sur les autres langues.

Pour le français en particulier :

- Les valeurs de perplexité de référence sont calculées sur des modèles linguistiques majoritairement anglais

- Les patterns de burstiness diffèrent structurellement entre l’anglais et le français (structures grammaticales différentes, longueur moyenne des mots différente)

- Les faux positifs et faux négatifs sont plus fréquents sur les textes français analysés avec des outils anglophones

Un texte en français analysé par GPTZero ou Winston AI (principalement anglophones) donne des résultats moins fiables qu’un texte anglais du même type. C’est pourquoi des outils spécifiquement entraînés sur le français — comme veriftexte.fr — sont nécessaires pour des analyses pertinentes.

Limite 5 — Les textes hybrides sont très difficiles à analyser

Un texte hybride — partiellement généré par IA, partiellement rédigé par un humain — est l’angle mort le plus important des détecteurs actuels.

Cas typique : un étudiant génère une structure et des sections avec ChatGPT, puis réécrit certains passages, ajoute ses propres exemples et reformule les transitions. Le résultat est un texte dont 40 % est IA et 60 % est humain.

Les détecteurs produisent des résultats très hétérogènes sur ces textes hybrides :

- Certains donnent un score global qui « moyenne » les deux parties (peu informatif)

- D’autres avec une heatmap phrase par phrase permettent d’identifier les passages suspects

- Tous sont moins fiables que sur les textes « purs »

La tendance vers les textes hybrides est croissante — c’est le cas d’usage le plus répandu en 2026. Et c’est précisément là où les outils actuels sont les moins performants.

Limite 6 — La course aux armements permanente

Les détecteurs sont en retard structurel sur les générateurs.

Chaque nouvelle version de ChatGPT, Claude ou Gemini modifie les patterns statistiques de génération. Les détecteurs doivent être réentraînés pour s’adapter. Mais le réentraînement prend du temps — et pendant ce délai, les nouveaux modèles IA génèrent des textes que les détecteurs existants reconnaissent mal.

De plus, les fournisseurs d’outils de paraphrase (QuillBot, Grammarly) améliorent constamment leurs algorithmes pour produire des textes plus naturels — avec comme effet secondaire de rendre les textes IA paraphrasés de plus en plus indétectables.

C’est une course aux armements sans ligne d’arrivée. La détection parfaite est théoriquement impossible tant que les modèles IA peuvent imiter n’importe quel style humain.

Limite 7 — L’incohérence entre les outils

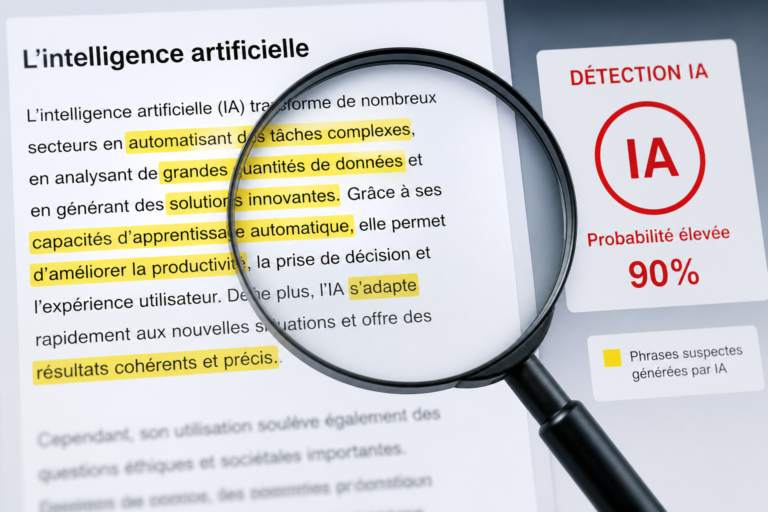

Si vous soumettez le même texte à GPTZero, Scribbr et QuillBot simultanément, vous obtiendrez souvent des scores très différents — parfois divergents de plus de 30 points.

Cette incohérence est révélatrice du fait que ces outils ne mesurent pas une vérité objective, mais des probabilités calculées selon des modèles de référence différents. Aucun n’est « le vrai score » — ce sont des estimations différentes du même phénomène.

Conséquence pratique : ne prenez jamais de décision sur la seule base d’un score d’un seul outil. Croisez minimum deux outils indépendants, et n’agissez que quand ils convergent.

Ce que ces limites impliquent en pratique

Pour les enseignants et institutions

- Un score de détection n’est jamais une preuve — c’est un signal d’alerte

- Les faux positifs existent et peuvent affecter des étudiants innocents — ne sanctionnez jamais sur un score seul

- Complétez toujours avec un entretien oral sur le travail, une vérification des sources, et une comparaison avec les travaux précédents de l’étudiant

- Soyez particulièrement prudent sur les textes rédigés par des non-natifs

Pour les rédacteurs et professionnels

- Testez vos propres textes avant livraison — votre style pourrait involontairement déclencher des faux positifs

- Si vous utilisez l’IA comme outil, une réécriture significative peut ne pas suffire à passer tous les détecteurs

- Proposez la transparence à vos clients sur votre usage de l’IA plutôt que de vous fier à la non-détection

Pour les étudiants

- Ne supposez pas qu’un texte IA remanié ne sera pas détecté — les méthodes de détection évoluent

- Sachez que la soutenance orale reste le test ultime qu’aucun outil ne peut passer à votre place

- Testez votre propre travail honnête pour vérifier qu’il ne déclenche pas de faux positifs

FAQ — Limites des détecteurs IA

Un détecteur IA à 99 % de précision peut-il encore se tromper ?

Oui, toujours. Un taux de précision de 99 % signifie qu’un texte sur 100 est mal classé. Si un enseignant analyse 30 copies, il y a une probabilité significative qu’au moins une soit mal évaluée. Et ces taux de précision sont généralement mesurés dans des conditions idéales (textes purs, en anglais) — pas sur des textes hybrides en français.

Les détecteurs s’améliorent-ils assez vite face à l’évolution des LLM ?

Les meilleurs outils publient des mises à jour régulières de leurs modèles. Mais le délai entre la sortie d’un nouveau LLM et l’adaptation des détecteurs crée toujours une fenêtre de vulnérabilité. La course aux armements est structurellement favorable aux générateurs.

Existe-t-il une limite théorique à la détection IA ?

Oui — si un modèle IA peut parfaitement imiter le style d’un auteur humain spécifique (avec ses tics de langage, ses références culturelles, ses erreurs caractéristiques), la distinction devient théoriquement impossible pour un algorithme statistique. C’est un horizon qui approche progressivement avec l’amélioration des modèles.

Conclusion

Les détecteurs IA sont des outils utiles mais imparfaits. Leurs limites sont réelles et documentées : faux positifs sur les textes formels, faux négatifs sur les textes remaniés, performances dégradées sur les textes courts ou en français, incohérence entre les outils, et course aux armements permanente avec les générateurs. Utilisés intelligemment — comme premier filtre, croisés entre eux, intégrés dans un processus humain plus large — ils apportent une valeur réelle. Utilisés comme oracle unique et infaillible, ils peuvent conduire à des erreurs graves. La lecture humaine contextuelle reste irremplaçable.