Comment les profs détectent-ils les devoirs écrits par l’IA ?

Depuis la popularisation de ChatGPT, les enseignants du secondaire, du supérieur et des grandes écoles font face à un défi nouveau : comment identifier les devoirs rédigés par une IA parmi les dizaines ou centaines de copies qu’ils reçoivent ? Beaucoup d’étudiants supposent que la détection est difficile, voire impossible. La réalité est plus nuancée — et de plus en plus défavorable à ceux qui tentent de passer entre les mailles du filet. Ce guide explique précisément comment les enseignants détectent les devoirs IA, pour que vous compreniez ce que vous risquez et comment éviter les faux pas.

Pour comprendre les implications légales et les sanctions possibles, consultez notre guide complet sur l’IA et le plagiat académique.

Méthode 1 — La lecture intuitive expérimentée

La première ligne de détection n’est pas un algorithme — c’est l’enseignant lui-même. Un professeur qui lit des dizaines ou centaines de copies par an développe une sensibilité aux patterns de l’écriture de ses étudiants.

Ce que l’œil exercé repère

Un registre inhabituellement formel Un étudiant qui écrit habituellement avec des fautes mineures et un registre oral rend soudainement une copie parfaitement construite, sans hésitations stylistiques. Le décalage est immédiatement perceptible.

Des transitions trop lisses et trop prévisibles « En premier lieu… En second lieu… Enfin… En conclusion… » — cette structure scolaire parfaitement respectée sur 10 pages, sans aucune digression, aucune formulation personnelle, aucun accroc de pensée visible, est suspecte.

L’absence de voix personnelle Les bons enseignants connaissent la façon d’écrire de leurs étudiants — leurs tournures habituelles, leurs références récurrentes, leurs maladresses caractéristiques. Un texte qui en est totalement dépourvu attire l’attention.

Des formules IA typiques Certaines expressions sont quasi-signatures de ChatGPT : « Il est important de noter que… », « Dans un monde en constante évolution… », « Il convient de souligner que… », « Cette approche multidimensionnelle permet de… ». Un enseignant qui lit régulièrement des copies IA finit par les reconnaître immédiatement.

Des exemples génériques Les exemples fournis par une IA sont généralement très généraux — « comme le montrent de nombreuses études », « selon les experts du domaine », sans jamais de référence précise et vérifiable. Un étudiant qui a vraiment travaillé son sujet cite des sources spécifiques.

Méthode 2 — Les outils de détection automatisée

Les établissements investissent de plus en plus dans des outils algorithmiques de détection. Certains sont intégrés directement dans les plateformes de dépôt de devoirs (Moodle, Blackboard, Canvas).

Turnitin — La référence intégrée

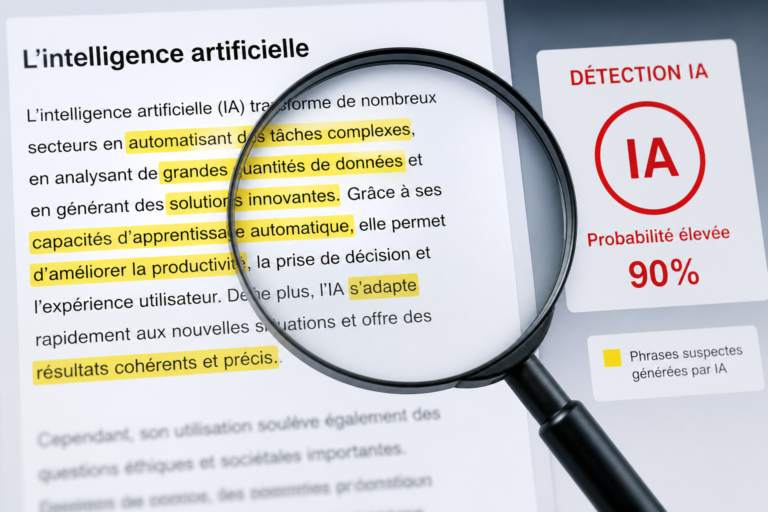

Turnitin, outil historiquement spécialisé dans la détection de plagiat classique, a développé un module de détection IA depuis 2023. Il est désormais déployé dans de nombreuses universités françaises et internationales.

Ce qu’il analyse : Turnitin calcule un score de probabilité IA sur l’ensemble du document, en identifiant les passages suspects phrase par phrase. Il génère un rapport consultable par l’enseignant.

Sa limite principale : il n’est pas infaillible. Des faux positifs existent, notamment sur les textes académiques très formels rédigés par des étudiants dont le style est régulier. C’est pourquoi Turnitin lui-même recommande de ne pas utiliser le score comme seul critère de décision.

GPTZero et outils équivalents

Certains enseignants utilisent des outils grand public comme GPTZero ou Scribbr pour analyser des copies individuelles suspectes. Ces outils donnent un score de probabilité IA et mettent en évidence les passages suspects.

La réalité de l’utilisation : peu d’enseignants ont le temps d’analyser systématiquement chaque copie avec ces outils — ils les utilisent principalement quand la lecture humaine a déjà généré un doute. Avant de remettre un devoir, vérifier son texte avec notre détecteur IA vous donne un aperçu de ce que l’enseignant pourrait voir.

Méthode 3 — La comparaison longitudinale

C’est l’une des méthodes les plus efficaces et les plus sous-estimées par les étudiants.

Un enseignant qui suit un étudiant sur plusieurs semaines ou plusieurs mois dispose d’un référentiel de comparaison. Il a lu des emails, des participations en cours, des brouillons, des rendus précédents — autant d’éléments qui lui donnent une image précise du niveau et du style de l’étudiant.

Les signaux d’alerte :

- Un étudiant qui rend un devoir de qualité très supérieure à ses habituelles

- Une évolution stylistique soudaine et inexpliquée entre deux rendus

- Un vocabulaire ou des références qui ne correspondent pas au niveau habituellement observé

- Une copie sans les « tics » d’écriture habituels de l’étudiant

Cette méthode est particulièrement efficace sur les petites promotions où les enseignants connaissent bien leurs étudiants. Elle l’est moins dans les grands amphithéâtres où un enseignant a 300 étudiants.

Méthode 4 — La vérification des sources et des faits

ChatGPT hallucine — il invente des sources, des statistiques, des noms d’auteurs, des dates. Un enseignant spécialiste de son domaine repère immédiatement ces erreurs factuelles.

Ce que les enseignants vérifient :

Les citations bibliographiques : une référence à un article scientifique ou à un livre qui n’existe pas, un auteur à qui est attribué un propos qu’il n’a jamais tenu, une date de publication incorrecte — autant de signaux d’hallucination IA immédiatement détectables par un expert du domaine.

Les statistiques : un chiffre précis cité sans source vérifiable (« selon une étude de 2023, 67,3 % des… ») est suspect. L’enseignant peut vérifier en quelques secondes si cette statistique existe réellement.

Les exemples : une référence à un « cas bien connu » qui est en réalité fictif, ou une description incorrecte d’un événement réel.

Conseil pratique : si vous utilisez l’IA comme outil de recherche, vérifiez systématiquement chaque fait, chaque chiffre et chaque source avant de l’inclure dans votre devoir.

Méthode 5 — L’entretien oral sur le travail rendu

C’est la méthode la plus redoutable — et la plus difficile à contourner. Quand un enseignant a un doute sérieux, il peut convoquer l’étudiant pour discuter de son travail.

Ce que l’entretien révèle

Un étudiant qui a réellement écrit son devoir peut :

- Expliquer ses choix argumentatifs

- Développer ses idées au-delà de ce qui est écrit

- Corriger ou nuancer ses propres affirmations

- Répondre à des questions de fond sur les concepts abordés

- Reconnaître ses sources et les contextualiser

Un étudiant qui a utilisé ChatGPT sans s’impliquer dans le contenu :

- Peine à expliquer pourquoi il a choisi tel angle plutôt qu’un autre

- Est incapable de développer une idée du texte autrement qu’en la répétant

- Ne peut pas répondre à des questions de fond sur son propre devoir

- Cite des « sources » qu’il n’a pas lues

L’entretien oral est le test ultime que no outil automatique ne peut passer à la place de l’étudiant. Dans les établissements qui le pratiquent systématiquement pour les devoirs importants (mémoires, thèses, grands projets), le taux de détection est très élevé.

Méthode 6 — L’analyse du délai de rendu

Les enseignants observent aussi les métadonnées comportementales — non pour espionner, mais parce que certains patterns sont révélateurs.

Un devoir remis en 3 heures Un travail de 10 pages nécessitant normalement 2 à 3 jours de recherche et de rédaction, rendu 3 heures après l’ouverture du dépôt, est suspect. Ce n’est pas une preuve — certains étudiants sont très rapides — mais c’est un facteur qui renforce un doute préexistant.

Un devoir remis à la dernière minute avec une qualité inhabituelle Inversement, un étudiant habituellement en retard qui rend subitement un travail parfait à l’heure exacte de la deadline peut attirer l’attention.

Ces observations ne sont jamais utilisées seules comme critère — mais elles s’intègrent dans un faisceau d’indices.

Ce que les enseignants ne peuvent pas (encore) détecter facilement

Soyons honnêtes — la détection a ses limites.

Les textes hybrides bien travaillés Un texte IA fortement remanié par un étudiant — restructuré, enrichi de références vérifiées, personnalisé dans le style — est très difficile à identifier. À ce stade, il s’agit d’un texte partiellement humain, et la frontière avec un usage « légal » de l’IA devient floue.

Les textes courts Sur des devoirs courts (moins de 300 mots), les outils algorithmiques manquent de données pour un diagnostic fiable. La détection humaine reste le principal recours.

Les étudiants qui comprennent vraiment le sujet Un étudiant qui utilise l’IA pour s’inspirer, structurer ses idées et générer une base, mais qui maîtrise réellement le sujet et peut le défendre oralement, sera difficile à détecter — parce que son usage de l’IA est, dans les faits, proche d’un usage d’assistance légitime.

Ce que les étudiants ne comprennent souvent pas

La détection n’est pas que algorithmique Beaucoup d’étudiants croient qu’il suffit de « déjouer » les outils automatiques pour être en sécurité. La réalité est que l’enseignant lui-même est le premier et souvent le plus efficace des détecteurs.

Les enseignants partagent leurs observations Dans les équipes pédagogiques, les cas suspects remontés par un enseignant sont souvent vérifiés transversalement — un étudiant suspect dans un cours peut voir ses autres travaux examinés de plus près.

Le risque augmente avec le temps Les outils s’améliorent, les enseignants se forment, les procédures se structurent. Parier sur la non-détection aujourd’hui, c’est parier sur une situation qui évolue défavorablement.

FAQ — Détection des devoirs IA par les profs

Un enseignant peut-il sanctionner uniquement sur un score Turnitin élevé ?

Non — et il ne devrait pas. Un score de détection IA est un indice, pas une preuve. La procédure standard implique un entretien avec l’étudiant et un faisceau d’indices. Une sanction sur la seule base d’un score algorithmique sans procédure contradictoire serait contestable.

Un devoir remanié après génération IA est-il détectable ?

C’est là que la détection devient incertaine. Un texte significativement remanié — restructuré, enrichi, personnalisé — peut passer sous les radars algorithmiques. Mais un entretien oral sur le travail reste redoutable.

Les petites universités sont-elles moins vigilantes que les grandes écoles ?

Pas nécessairement. Les grandes écoles ont des procédures plus formalisées et des outils plus déployés. Mais dans les petits établissements, les enseignants connaissent mieux leurs étudiants — ce qui rend la détection par lecture humaine souvent plus efficace.

Conclusion

Les enseignants disposent d’un arsenal de détection bien plus large que la plupart des étudiants ne l’imaginent : lecture humaine expérimentée, outils algorithmiques, comparaison longitudinale, vérification des sources, et surtout l’entretien oral. Aucune de ces méthodes n’est infaillible prise isolément — mais leur combinaison est de plus en plus efficace. La meilleure protection reste d’utiliser l’IA de façon déclarée et encadrée, de comprendre réellement le sujet traité, et d’être capable de défendre son travail oralement.